Intelligently R

Wir integrieren AI in Daten- und Analyse-Workflows, entwickeln Open-Source-AI-Tools und bieten Infrastruktur-Support für R- und Posit-Umgebungen.

Unsere Leistungen

Agentische Coding-Tools, die Code autonom schreiben, refaktorisieren und debuggen, plus Inline-Autocomplete für schnelleres Arbeiten. Wir richten Claude Code, GitHub Copilot, Cursor oder lokale Alternativen ein und haben Erfahrung mit der Integration in R/Posit und eingeschränkte Verwaltungsumgebungen.

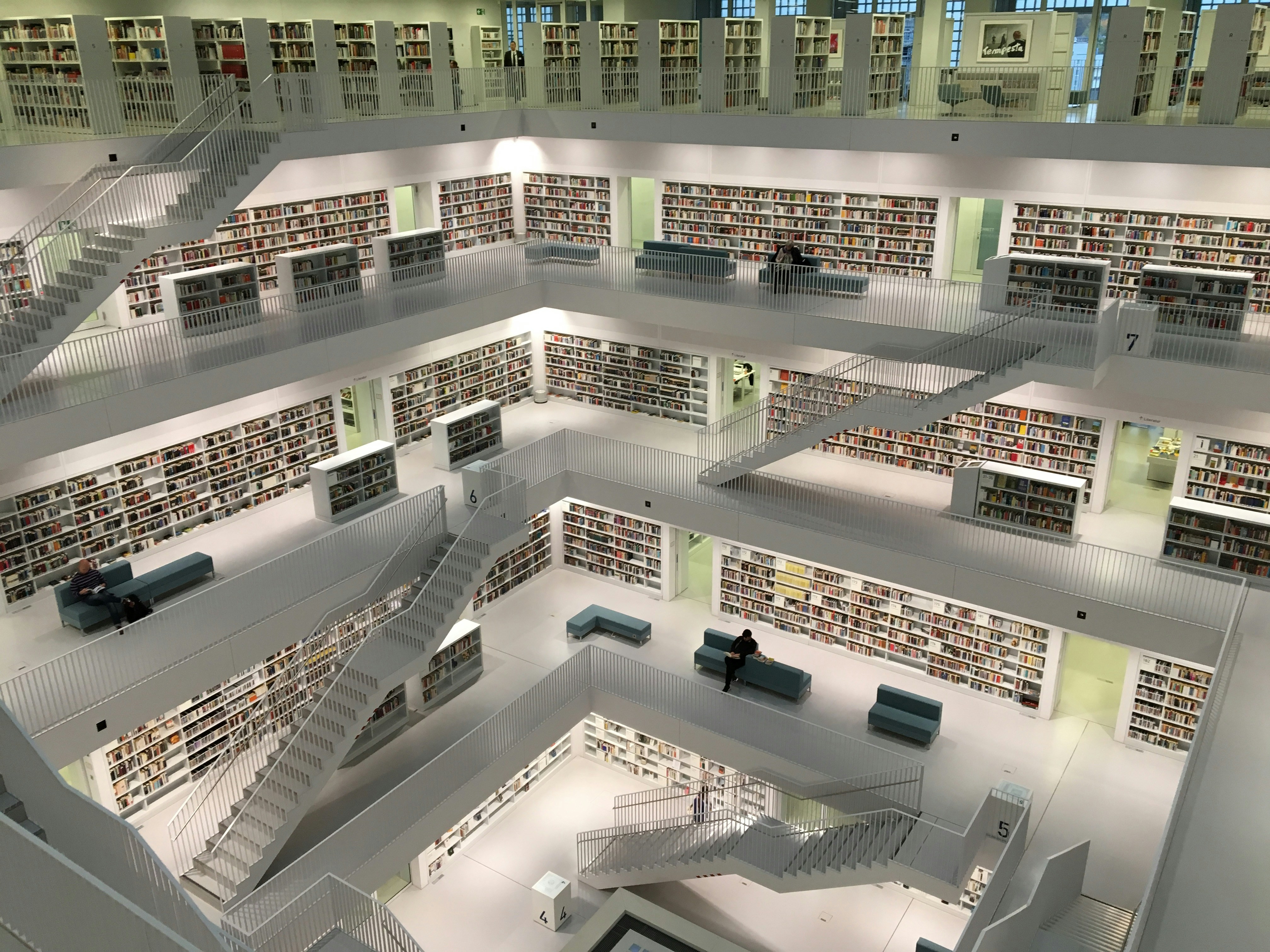

Interne Dokumente mit AI durchsuchbar machen. Antworten basieren auf Ihren Daten, nicht auf generischen Texten. Vollständig lokaler Betrieb möglich, sodass Daten Ihre Server nie verlassen. Aufgebaut mit ChromaDB, DuckDB und rchroma, unserem Open-Source-R-Package.

Stellen Sie Fragen an Datenbanken und Datensätze in natürlicher Sprache. Erstellen Sie Grafiken, filtern Sie Daten, generieren Sie Zusammenfassungen, indem Sie beschreiben, was Sie möchten. Auch ohne Programmierkenntnisse nutzbar. Basiert auf blockr.ai, unserem Open-Source-Framework.

So arbeiten wir

Vom ersten Gespräch bis zum laufenden System.

Verstehen

Discovery

Wir besprechen Ihre Ziele, finden heraus, wo AI hilft, und schauen uns Ihre Rahmenbedingungen an: Hardware, Budget, Datenschutz und bestehende Infrastruktur.

Entwerfen

Design

Wir wählen das richtige Setup: Cloud, Self-hosted oder hybrid. Wir bestimmen die Tools und Modelle, die zu Ihrem Anwendungsfall und Sicherheitsbedarf passen.

Liefern

Umsetzung

Wir richten das System ein, integrieren es in Ihre Umgebung und schulen Ihr Team. Wir bleiben für laufenden Support, Anpassungen und Weiterentwicklung verfügbar.

Fokus-Projekt

rchroma provides an R interface to ChromaDB, enabling vector database operations directly from R. It supports embedding storage, retrieval, and similarity search for AI applications.

Key Features

- Vector database operations in R

- Storage and retrieval of embeddings

- Similarity search for AI applications

- Integration with R machine learning workflows

Our ask package lets you interact with AI models directly from R, going beyond simple text responses.

Key Features

- Script and documentation editing in place

- Code and test generation

- Package documentation querying

- Natural language data processing

- Support for both cloud (GPT-4) and local (LLama) models

blockr.ai extends our blockr framework with AI capabilities for natural language-driven data analysis.

Key Features

- AI-powered plot creation through natural language

- Intelligent data transformations

- Integration with leading AI models

- Composable blocks for flexible workflows

- Seamless integration with the blockr ecosystem

Cloud vs. Lokal

-

Cloud mit Zero Data Retention

Claude API, GitHub Copilot Business, Azure OpenAI. Beste Performance, keine Daten beim Anbieter gespeichert.

-

Self-Hosted LLMs

Modelle auf Ihrer eigenen Infrastruktur mit Ollama, Open WebUI oder dedizierten GPU-Servern. Daten bleiben in Ihrem Netzwerk.

-

Hybrid

Cloud für unkritische Aufgaben, lokale Modelle für sensitive Daten. Wir nutzen eine Entscheidungsmatrix, um jeden Anwendungsfall gegen Datensensitivität, Qualitätsanforderungen und Budget abzuwägen.

AI-Einblicke

Praktische Beispiele für die Arbeit mit LLMs in R

David Schoch, Christoph Sax /

R with RAGS: An Introduction to rchroma and ChromaDB

LLM/RAG/R

Large language models (LLMs) are developing rapidly, but they often lack real-time, specific information. Retrieval-augmented generation (RAG) addresses this by letting LLMs fetch relevant documents during text generation, instead of just using their internal—and potentially outdated— knowledge.

Christoph Sax /

Playing with AI Agents in R

LLM/R

It's local LLM time! What an adventure it has been since I first started exploring local LLMs. With the introduction of various new Llama models, we now have impressive small and large models that run seamlessly on consumer hardware.

Christoph Sax /

Playing with Llama 3.1 in R

LLM

Meta recently announced Llama 3.1, and there's a lot of excitement. I finally had some time to experiment with locally run open-source models. The small 8B model, in particular, produces surprisingly useful output, with reasonable speed.